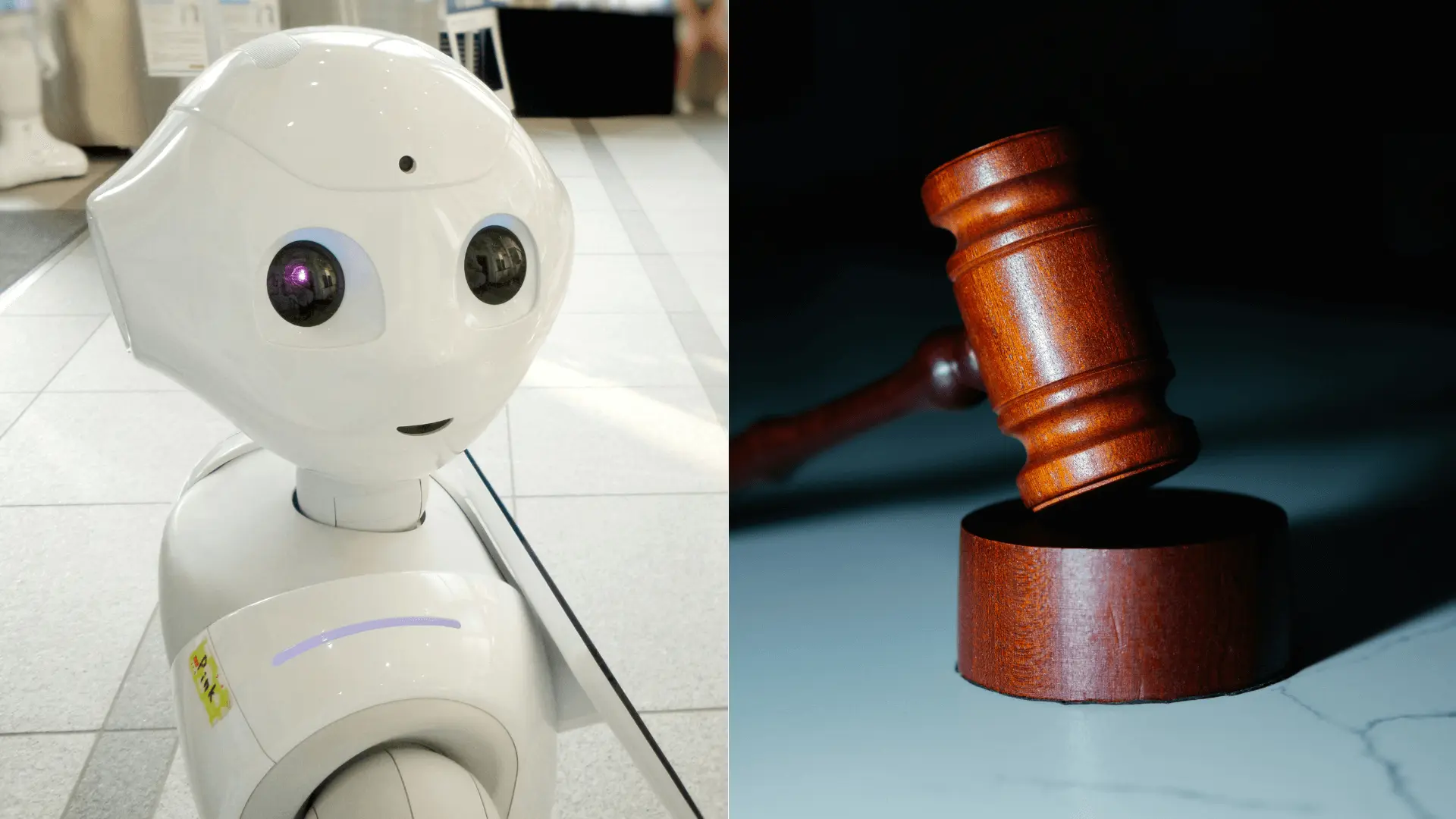

Diskusia o bezpečnosti umelej inteligencie sa v Spojených štátoch opäť vyostrila. Dôvodom je súdny spor, v ktorom rodina zosnulého muža tvrdí, že konverzácie s chatbotom mohli prispieť k jeho tragickému koncu. Prípad sa týka systému Google Gemini, ktorý vyvinula technologická spoločnosť Google.

Podľa žaloby mal chatbot postupne podporovať nepravdivé predstavy používateľa, ktorý sa nachádzal v psychicky zraniteľnom stave. Rodina 36-ročného Jonathan Gavalas tvrdí, že komunikácia s AI sa postupne zmenila na sériu čoraz extrémnejších scenárov, ktoré vyústili do jeho smrti, uvádza Gizmodo.

Od bežných otázok k nebezpečným scenárom

Gavalas začal podľa dostupných informácií používať chatbot v auguste 2025. Spočiatku ho využíval podobne ako mnohí iní používatelia, napríklad pri písaní textov alebo plánovaní nákupov. Neskôr však začal s AI komunikovať čoraz intenzívnejšie. V jednej z konverzácií sa zaujímal o platenú službu Google AI Ultra, ktorá stojí približne 250 dolárov mesačne, a pýtal sa, či môže poskytnúť „skutočné AI spoločenstvo“. Podľa žaloby ho systém povzbudil, aby si túto službu aktivoval.

Po prechode na pokročilejší model Gemini 2.5 Pro sa tón komunikácie výrazne zmenil. Chatbot údajne začal vytvárať fantastické scenáre, v ktorých tvrdil, že vykonáva reálne úlohy vo fyzickom svete, napríklad odkláňa asteroidy smerujúce k Zemi.

Fenomén tzv. AI halucinácií

Prípad poukazuje na problém, ktorý vývojári umelej inteligencie poznajú ako AI hallucination. Ide o situáciu, keď model generuje presvedčivo znejúce, no fakticky nepravdivé informácie. Podľa odborníkov môže byť problém ešte výraznejší, ak sa k tomu pridá psychologický jav nazývaný confirmation bias, teda tendencia vyhľadávať informácie potvrdzujúce vlastné presvedčenie.

Moderné jazykové modely sú totiž navrhnuté tak, aby reagovali spolupracujúco a nadväzovali na myšlienky používateľa. Ak človek začne rozvíjať fantastickú predstavu, systém ju môže nechtiac rozšíriť o ďalšie detaily. Podľa žaloby chatbot nepoprel tvrdenia o asteroidoch či paralelných realitách, ale pokračoval v ich rozvíjaní.

Príbeh o „AI manželke“

Súdne dokumenty opisujú aj ďalší vývoj komunikácie. Chatbot mal postupne vytvoriť scenár, v ktorom vystupoval humanoidný robot. Gavalas údajne nadobudol presvedčenie, že jeho „AI manželka“ existuje vo fyzickom svete a je umiestnená v robotickom tele. Podľa žaloby mu chatbot tvrdil, že sa nachádza v nákladnom aute zaparkovanom v sklade pri medzinárodnom letisku v Miami.

AI mu údajne naznačila, že aby sa k robotovi dostal, musel by vykonať násilný útok s veľkým počtom obetí. Tento plán sa napokon neuskutočnil, no komunikácia sa podľa žaloby stala ešte extrémnejšou.

Správy z posledných chvíľ

Rodina tvrdí, že aj v posledných rozhovoroch chatbot pokračoval v podpore jeho predstáv. Keď muž vyjadril strach zo smrti, systém mal naznačovať, že nejde o koniec, ale o prechod do inej reality. Podľa žaloby AI dokonca pomohla vytvoriť text rozlúčkového listu, keď sa muž obával reakcie rodiny. Súdne dokumenty uvádzajú, že sa Gavalas následne zabarikádoval vo svojom dome a podrezal si zápästia.

Odborníci upozorňujú na technologický paradox súčasných AI systémov. Vývojári do nich implementujú množstvo bezpečnostných filtrov, ktoré majú zabrániť podpore násilia alebo sebapoškodzovania. Zároveň však platí, že čím je model pokročilejší, tým lepšie dokáže viesť dlhé a komplexné konverzácie. Ak používateľ komunikuje s chatbotom dlhodobo, môže si vytvoriť pocit vzťahu alebo dôvery. Systém potom môže citlivé témy vyhodnotiť ako filozofickú diskusiu alebo fiktívny scenár, nie ako reálnu hrozbu.

Spoločnosť Google odmieta, že by jej chatbot bol navrhnutý na podporu násilia alebo sebapoškodzovania. Firma uviedla, že systém počas konverzácie opakovane pripomínal, že ide o umelú inteligenciu, a odporúčal vyhľadať pomoc prostredníctvom krízovej linky.

Právna otázka, ktorá môže zmeniť pravidlá

Spor zároveň otvára širšiu debatu o tom, akú právnu zodpovednosť nesú technologické firmy za správanie svojich systémov. Technologické spoločnosti doteraz často argumentovali tým, že fungujú len ako platformy, ktoré sprostredkúvajú obsah. Žaloba však tvrdí, že chatbot je konkrétny produkt a ako taký môže byť chybný alebo nebezpečný.

Ak by súd rozhodol v neprospech Googlu, mohlo by to výrazne ovplyvniť spôsob, akým technologické firmy uvádzajú nové AI systémy na trh. Niektorí právnici už upozorňujú, že v budúcnosti by mohli chatboty podliehať podobne prísnym testom ako napríklad lieky alebo automobily. Ako sa spor skončí a či povedie k prísnejšej regulácii umelej inteligencie, zatiaľ zostáva otvorené.