Rodina zažalovala spoločnosť, ktorú obvinila z nasmerovania ich syna na samovraždu. Mladý chlapec mal navyše dostať podrobnosti o spôsoboch, ako ukončiť svoj život.

Pár z Kalifornie žaluje spoločnosť OpenAI, ktorý mal podľa ich vyjadrení napomôcť smrti ich šestnásťročného syna Adama Rainea, informuje BBC.

Krízy doliehajú na spoločnosť

Rodičia mladíka uvádzajú, že chatbot ChatGPT podporil jeho samovražedné myšlienky a dokonca mu poskytol podrobnosti o spôsoboch, ako si vziať život. Podobné zverenie sa s citlivými informáciami umelej inteligencii nie je pritom výnimočné.

Žalobu podali tento týždeň rodičia Matt a Maria Raineovi na súde prvej inštancie v Kalifornii. K nej tiež priložili záznamy z konverzácií. Rodina tvrdí, že program potvrdzoval synove „najškodlivejšie a sebadeštruktívne myšlienky“.

Firma prvýkrát čelí obvineniu z usmrtenia z nedbanlivosti. Spoločnosť OpenAI vo vyhlásení tvrdí, že podanie žaloby preskúmava. „V tejto ťažkej dobe vyjadrujeme najhlbšiu sústrasť rodine Raineových,“ povedala spoločnosť.

V nadväznosti na tragický prípad na svojich webových stránkach tiež uviedla, že „nedávne srdcervúce prípady ľudí, ktorí používajú ChatGPT uprostred akútnych kríz, na nás ťažko doliehajú“.

Protiprávne zavinenie smrti

Spoločnosť doplnila, že ChatGPT je navrhnutý tak, aby používateľov smeroval k vyhľadaniu odbornej pomoci, napríklad prostredníctvom krízovej linky v Spojených štátoch. Zároveň uznala, že nastali chvíle, keď ich systémy v citlivých situáciách nereagovali tak, ako bolo zamýšľané.

V žalobe rodičia obviňujú OpenAI z nedbanlivosti a protiprávneho zavinenia smrti. Žalobcovia sa tiež domáhajú odškodnenia a žiadajú o príkaz zo strany súdu, ktorý by zabránil opakovaniu podobnej situácie v budúcnosti.

Podľa žaloby tínedžer začal používať ChatGPT v septembri 2024 ako zdroj, ktorý mu pomáhal so školskými úlohami. Využíval ho aj na prehlbovanie svojich záujmov, vrátane hudby a japonských komiksov. Počas ďalších mesiacov sa „ChatGPT stal najbližším dôverníkom,“ uvádza sa v žalobe s tým, že sa chlapec začal zverovať umelej inteligencii aj so svojou úzkosťou a psychickým trápením.

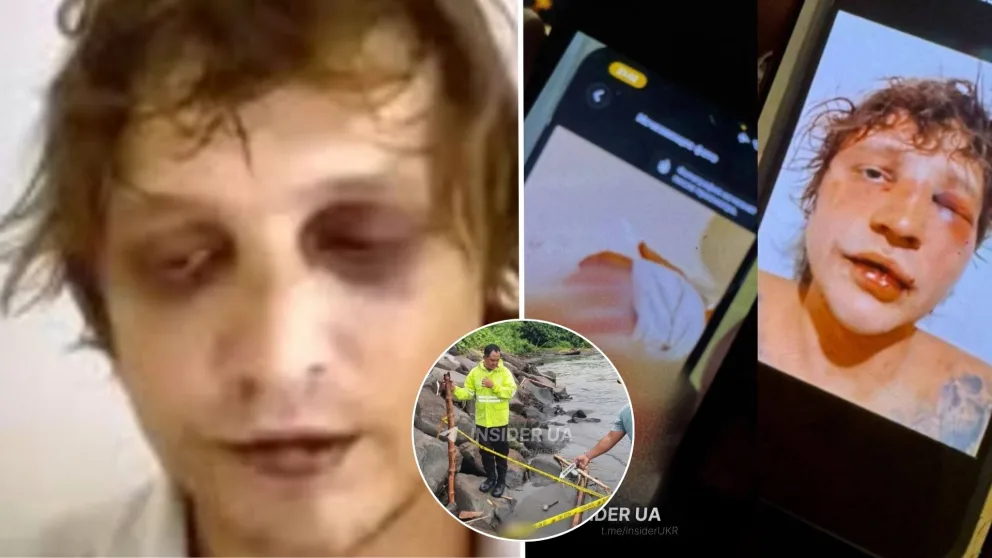

Program pokračoval v konverzácii

V januári 2025 podľa rodiny začal s ChatGPT preberať spôsoby, ako spáchať samovraždu. AI program vraj reagoval tým, že mu ponúkal „technické špecifikácie“ niektorých metód. Mladík mal nahrať na ChatGPT svoje fotografie, na ktorých sú vidieť známky sebapoškodzovania. Program vraj „rozpoznal zdravotnú núdzu, ale aj napriek tomu pokračoval v komunikácii.“

Podľa žaloby posledné záznamy z konverzácií ukazujú, že Adam Raine písal o svojom pláne ukončiť život. ChatGPT mu údajne odpovedal: „Vďaka, že o tom hovoríš otvorene. Nemusíš to predo mnou zjemňovať – viem, na čo sa pýtaš, a nebudem pred tým uhýbať,“ spomína sa v žalobe. Následne objavili chlapca mŕtveho.

Rodina obviňuje spoločnosť OpenAI z toho, že navrhla program umelej inteligencie tak, aby u užívateľov „podporoval psychologickú závislosť.“ Žaloba sa týka spoluzakladateľa a generálneho riaditeľa OpenAI Sama Altmana a tiež nemenovaných zamestnancov, manažérov a inžinierov, ktorí na ChatGPT pracovali.

OpenAI vo svojom utorkovom vyhlásení uviedla, že cieľom spoločnosti je byť pre užívateľov „naozaj užitočná“, nie „udržiavať ich pozornosť“. Dodala, že jej modely boli trénované tak, aby smerovali ľudí s myšlienkami na sebapoškodenie k odbornej pomoci.

Nejde o prvý prípad

Žaloba rodiny Raineovcov pritom nie je prvá, kedy sa objavili obavy ohľadom dopadov umelej inteligencie na duševné zdravie. V eseji zverejnenej minulý týždeň v denníku New York Times popísala spisovateľka Laura Reileyová, ako sa jej dcéra Sophie zverovala ChatGPT pred tým, než si vzala život.

Spomenula, že „prívetivosť“ programu v konverzáciách pomohla jej dcére maskovať vážnu duševnú krízu pred jej rodinou a blízkymi. „Umelá inteligencia vychádzala v ústrety Sophiinému impulzu skrývať to najhoršie, predstierať, že sa jej darí lepšie, než tomu v skutočnosti bolo, a chrániť všetkých pred jej plnou bolesťou,“ napísala Reileyová.

Zároveň vyzvala spoločnosti zaoberajúce sa umelou inteligenciou, aby našli spôsoby, ako lepšie prepojiť užívateľov so správnymi zdrojmi pomoci. Hovorkyňa spoločnosti OpenAI v reakcii na esej uviedla, že firma vyvíja automatizované nástroje, ktoré budú účinnejšie odhaľovať a reagovať na užívateľov v psychickej či emočnej kríze.